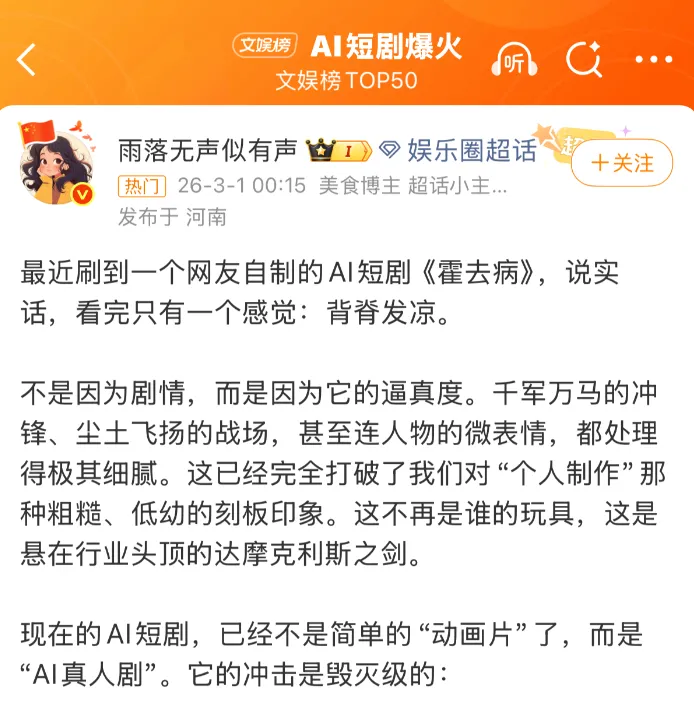

最近刚好在微博热榜上刷到关于AI短剧爆火的内容,讨论实在是太多了。

网友们也在纷纷评论AI已经打破了曾经的刻板印象,不敢相信是AI,甚至有人觉得影视行业的天都塌了,AI已经越来越以假乱真了。

我的好奇心也跟着一起激起,我就马上去看了下这个网友自制的AI短剧《霍去病》究竟长什么样。

看完之后我还是非常的震撼的,整个画面的精细化层度跟大片剧组投入大量的时间精力制作一样。

而这个作品《霍去病》是由创作者杨涵涵一个人用「纳米漫剧流水线」这个产品做的,你敢信吗?

纳米漫剧流水线地址:https://www.namistory.com/

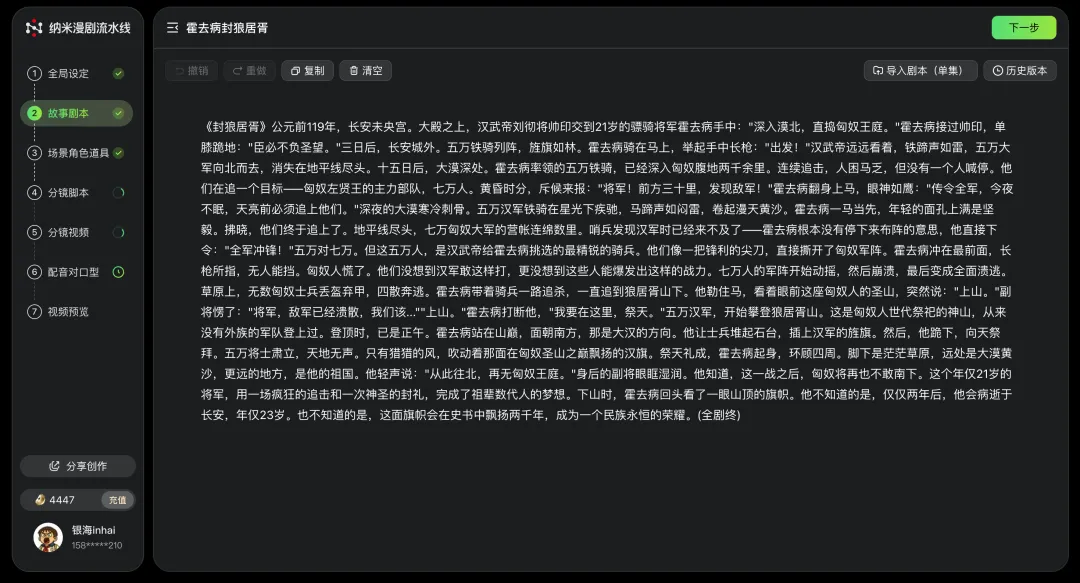

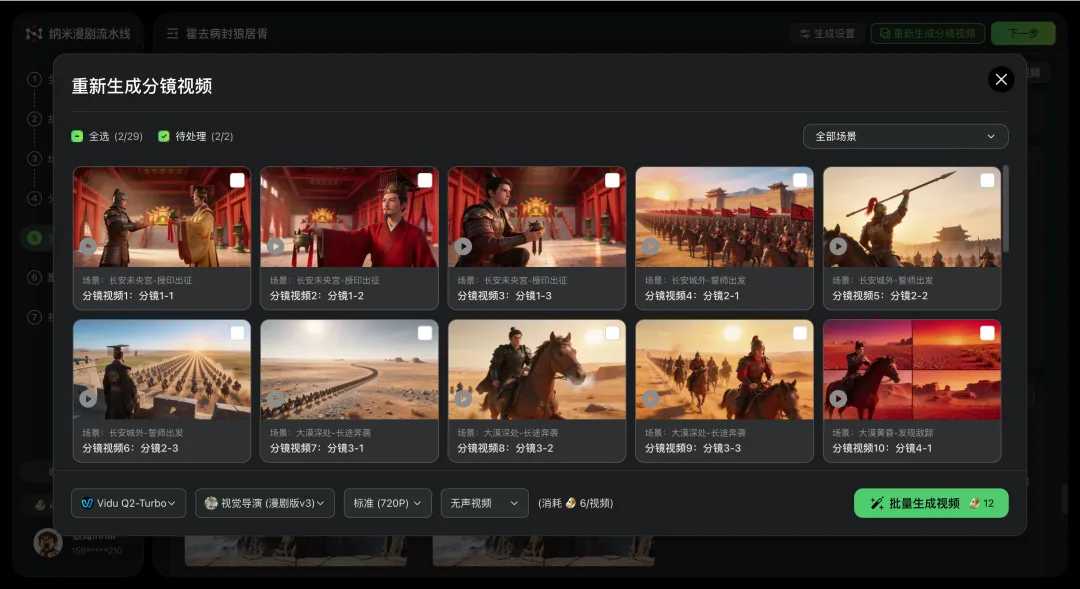

上图产品左侧这里的几个步骤,就很好地诠释了什么叫做「流水线」这个词,几个步骤清清楚楚呈现在面前。

前两天我还在排队等 Seedance 2.0,一开始我也不信没有 Seedance 2.0 也能做出这个效果?

爆火,加速,结果系统提示还要再等四十分钟...一句话生成视频很爽,但当创作节奏被算力排队打断时,它更像一次抽卡体验。

所以我干脆关掉页面,自己去完整走了一遍爆火的纳米漫剧流水线的 SOP,这一趟下来,我才真正理解“流水线”这个词为什么这么贴切。

如果说 Seedance 2.0 在视频画质天花板上突破了,那么我觉得今天分享的这个纳米漫剧流水线负责把这个天花板稳定地工业化复制。

以前我们做漫剧,从剧本、角色设定、场景搭建到风格统一,全都要一项项手动推进,光是确定各种风格,就要反复试错和对齐,然后不断的跑视频生成抽卡。

而来到纳米漫剧流水线,没想到纳米里面竟然把风格全部设定好了,这里的风格已经超出我原来的想象范围,写实、3D、Q 版、像素风等等,各种风格库都已经准备好。

它是把“做一部短剧”这件事,从头到尾拆解成一条清晰的生产路径,我认为定位跟「工业级生产平台」这个名词更贴合,我甚至感觉它的整条链路达到了 seedance 2.0 的同款效果,每一帧都是旗舰级输出。

做漫剧的第一步,我从剧本开始,可以选择使用自己的原创故事,或者是选择已有的剧本直接导入,这里我就参考大赛的作品直接导入《霍去病封狼居胥》的剧本故事进行创作。

我导入文本之后,系统先做的是结构解析,它会自动的的把故事拆成场景段落,识别出角色出场、道具需求和环境变化,这一步很像前期筹备。

我能清楚看到故事被拆成一个个具体场景,每个场景对应哪些角色、需要哪些道具。

第二步,是更丰富的资产生成。

系统根据剧本拆解结果,分别生成场景图、角色图和道具图。

场景是建立故事空间的基础。

角色是串联整部剧集的长期资产。

道具是对于功能细节的内容补充。

它们是分开生成、分开确认的。

这一点让我很放心的原因是,自己之前用很多 AI 视频工具是直接出完整画面,结果后续一致性很难控制。

而在这里,我先确认角色长什么样,场景空间结构是否合理,道具是否符合设定。

我有一种参与前期美术设计的感觉,而不是等模型给我随机结果。

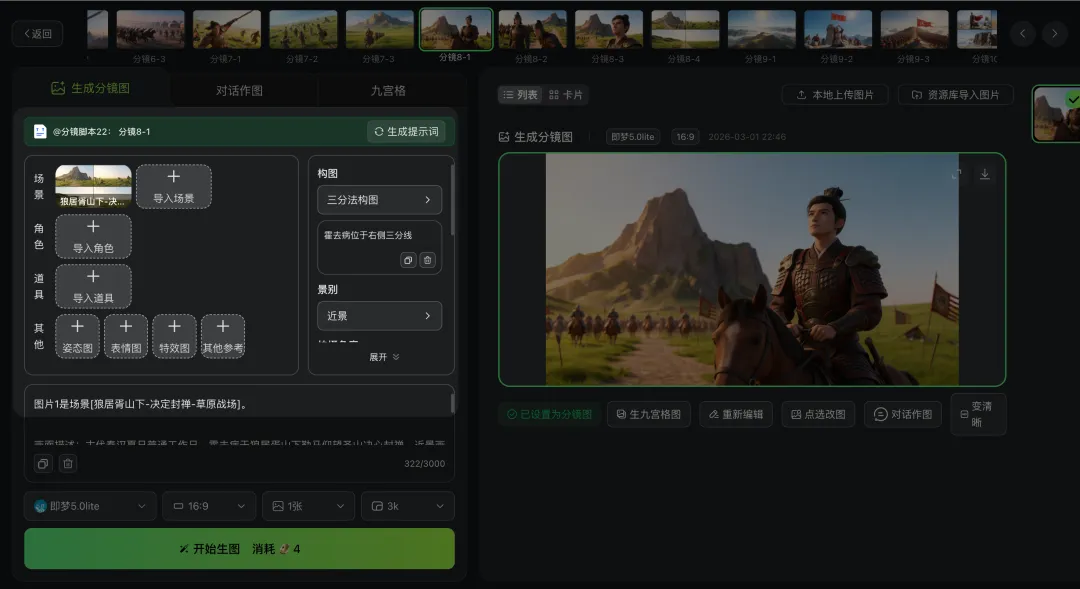

第三步,是分镜脚本生成。

资产确认后,系统自动帮我拆分镜头。我选了标准分镜结构,一共拆出了 33 个分镜。

每一个分镜都有画面描述、人物动作说明和镜头运动方式,我可以逐条查看。

如果对于某个分镜的镜头节奏和内容不满意,我可以直接改构图、景别、镜头运动,比如把平推改成环绕,把固定机位改成跟拍。

这一步让我第一次有了“导演”的感觉。

第四步,是生成分镜图。

我点击生成后,系统为每一个分镜自动生成对应画面。

比如说以前做镜头切换时,用一些传统的 AI 会导致背景会乱跳,左边的摆件跑到右边,环境布置的内容位置变了,人物前后关系颠倒。

过去很多 AI 在生成视频时,其实是没有真正的“空间感”的,它更像是在逐帧拼接画面,而不是理解一个完整的三维场景,所以人物一转头、镜头一切换,就容易出现风格漂移、角色变形的问题。

但我发现纳米在这方面做得相当稳定。

比如两个人面对面对话,镜头从 A 切到 B,再切回 A,人物的样貌、站位、光影关系都能保持在一个相对统一的状态,场景风格也不会明显跑偏。

这种连贯感,其实背后依赖的是对空间结构的理解,而不只是图像生成能力。

我也好奇的特意查了一下纳米这背后的技术思路,它的核心是构建一个视频世界模型,从底层去解决记忆问题。

官方提到系统性地处理三类记忆,让模型不只是记住画面,而是记住“空间里的关系”,所谓“空间引擎”。

具体做法上,纳米会为每个场景建立一个四视图的空间模型,包括正、反、左、右四个视角的参考图,同时结合空间关系图谱,把物体位置、深度信息、光照方向等要素结构化表达,构建出一个三维坐标体系。

这样一来,镜头无论怎么切换,模型都能基于同一个空间框架进行生成,而不是重新“猜”一张图。

接下来,我会逐帧检查构图是否合理,人物站位有没有问题,空间关系是否稳定,还可以直接出一些四宫格类的分镜图便于下一步的视频生成。

如果有不满意的地方,我可以单独修改某一条分镜描述重新生成,而不用推翻全部内容。

这种局部可控性,让我感觉这真的是在做制作,而不是玩生成。

第五步,是分镜视频生成。

当分镜图确认无误后,我开始为每个分镜生成视频片段,生成完成后,页面上出现了整整 33 段小视频,每一段都对应前面的分镜脚本。

如果我想增加一个过渡镜头,只需要补一条分镜描述,再生成那一段,整个结构非常清晰。

这个工业级流水线专业到里面的每个分镜的步骤,如果我对于画面还需要去做一些优化,都可以在镜头运动,拍摄手法,甚至对于画面描述都可以直接进行二次修改。

第六步,是配音和对口型。

我可以给主角配音,也可以添加旁白。音频生成之后,系统自动匹配口型。

这一刻画面真正变成了叙事,角色开口说话,情绪开始成立。

第七步,是整体预览与剪辑。

它全自动地把 33 个分镜视频按顺序拼接,包含了视频、配音、字幕、音乐等串联,直接整体预览节奏,如果某一段节奏太慢或者画面不对,我依旧可以回到分镜层去调整。

当最终导出完整视频时,我真的有点震撼。

这已经不再是“AI生成了一段画面”,这是我从剧本开始,一步步做出来的一部作品:从文本到资产,从资产到分镜,从分镜到视频,从视频到声音,再到最终剪辑。

当我把整条流程跑完之后,忍不住算了一笔账,我上面这部2分47秒的视频,经过多次打磨后,整体消耗的是近1000豆子,整体整本差不多是 100 元。

如果按单分镜成本来算,市面主流工具生成一个分镜大概在 3 元以上,而纳米是 1.54 元,单镜头算力成本直接下降 52%。

放大到整部作品,差距会非常明显。

再看人力产能,以往一个人一天可能只能稳定产出 3 到 5 分钟成片,而在流水线结构下,可以做到 10 到 15 分钟,产能接近 3 倍提升。

一句话生成视频,更像创意实验,解决的是“能不能做”。

完整的流水线,是工业级的创作结构,解决的是“能不能持续、规模化地做”。

当我真正想做一部完整动漫时,我需要角色一致性、场景稳定性、镜头可剪辑性和动作逻辑连贯性,这些并不是单次生成能解决的。

我不需要传统影视团队规模,也不需要复杂软件协作,就能完成一部结构完整的漫剧,但创作本身没有被简化。

我依然需要思考故事节奏、镜头语言、人物塑造,只是工具帮我把工程壁垒压缩了。

© THE END