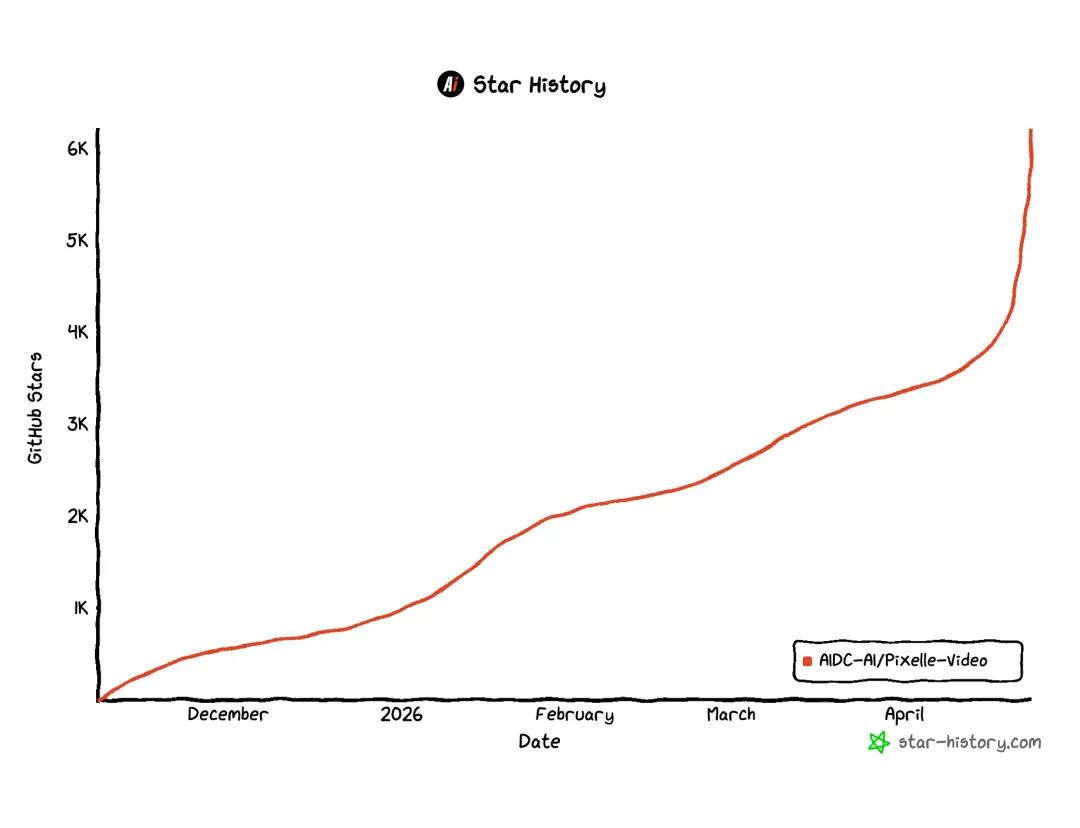

最近 GitHub trending(GitHub官方热榜) 上看到一个阿里开源的项目 项目名字叫 Pixelle-Video (6.2k star)。

项目名字叫 Pixelle-Video (6.2k star)。

阿里AIDC(阿里巴巴国际站数字商务集团的人工智能团队)开源的。

简介就那么一行字:“AI 全自动短视频引擎”。

没多想就点进去了,结果第一眼就给我干沉默了。

这玩意儿到底能干啥?

简单说,你随便扔个主题给它,比方说“为什么应该养成阅读习惯”,它能在几分钟之内给你吐出一个能直接发的短视频——不是那种套模板的垃圾货,是文案、画面、配音、BGM 全齐活的那种。

哦对了,它连配音都能克隆你的声音。

我当时脑子里就四个字:这合法吗?

随便拿 demo 跑了条视频出来,看完之后我坐在椅子上呆了好一会。不是震惊于效果有多惊艳——虽然确实还行——而是突然意识到,这玩意儿的效率,简直是把内容生产那层窗户纸直接给捅破了。

<<< 左右滑动见更多 >>>

视频转为了 GIF 格式,所以看起来卡卡的

它把活拆得太干净了

整个项目的思路一点都不花哨,就是把一条短视频的生产流程彻底拆开,每个环节扔给最合适的 AI 去干。

第一块,写稿。 接的是通义千问、GPT-4o、DeepSeek 这些大模型。你给个主题,它给你写脚本。你能指定风格,也能自己直接贴现成的文案,跳过这步。

第二块,出图。 对接 ComfyUI 或者线上的 RunningHub。它能把文案里每一句话自动配上插图,还能让你自定义画风,比如“极简黑白火柴人风格”。可玩性其实挺高的。

第三块,配音。 各种 TTS 方案都有,Edge-TTS、Index-TTS 啥的。最离谱的还是那个声音克隆——传一小段你自己的录音,它就能用你的调调念完整个文案。这功能要是被某些人拿去用,场面不敢想。

第四块,视频合成。 内置了好几套模板,横竖屏都有,自动把刚才生成的那些东西拼到一起,加个背景音乐就完事儿了。

这个拆分逻辑其实挺鸡贼的。短视频本来就是流水线作业,以前非得一个人全揽,质量肯定顾头不顾腚。现在把每个环节交给最强的 AI 模型,效率直接飞起。官方给的说法是,跑一个五分镜头的视频,一般几分钟就完活。

说实话,比我预想的快太多了。

对小白极度友好,好到有点意外

我认真翻了翻使用文档——说真的,现在很多开源项目就真的是“把代码开源了而已”,根本跑不起来。但 Pixelle-Video 明显不是那种画饼货。

Windows 用户直接去下那个一键整合包就完事了:

下载解压 双击 start.bat 浏览器自己弹出来 Web 界面 把 API Key 填上(通义千问或者 DeepSeek 的都行) 开干

不用你装 Python,也不用配置 uv,甚至连 ffmpeg 都提前打好了。这在开源圈里,真的算良心到姥姥家了。

macOS 或者 Linux 也没多麻烦,几行命令的事儿:

git clone https://github.com/AIDC-AI/Pixelle-Video.gitcd Pixelle-Videouv run streamlit run web/app.py成本这块就更不用担心了。想白嫖的话,LLM 用本地 Ollama(完全免费),再加上本地部署的 ComfyUI 跑图,全程零花费。要是想省点事又不想花钱,通义千问的 API 便宜得要死,差不多也是零成本。当然,你要不差钱非要用 OpenAI 和 RunningHub 云端跑,那也随你,只是没必要。

生态这东西,居然已经有模有样了

一个刚出来不久的开源项目,大家最怕的就是社区一片死寂,有问题没人答。但 Pixelle-Video 目前看下来,这块意外的成熟。

GitHub 页面上列了一堆已经能玩的资源:

好几种 TTS 工作流 声音克隆模板 静态的、动态背景的、图片背景的各种视频模板 跟 ComfyUI 的深度整合(懂行的可以直接拖进自己工作流) 作品生成后能自动推送到微信、飞书、钉钉、Telegram,甚至发邮件……

这些东西出来之后,意味着你根本不需要会敲代码,下了整合包就能用;要是你本来就在玩 ComfyUI,那直接装个节点就把这套流程集成进去了。

这种感觉不像一个刚发布几个月的项目,更像是内部打磨了很久才拿出来公开的玩意儿。我都怀疑是不是阿里内部有人自己用得挺爽,顺手就给开源了。

阿里这波节奏,是真的很紧凑

随便翻了一下最近几个月的发布节奏,挺有意思的。

Pixelle-Video 不是个单打独斗的孤例,它上面还有俩配套的项目:

Pixelle-MCP:把 ComfyUI 变成 MCP 服务器,让 AI 助手能直接调动 ComfyUI 干活。 FlowGram:一个帮开发者快速搭 AI 应用流程的框架。

感觉上,AIDC这边差不多是一个月往外出一个新的东西。那股子紧迫感隔着屏幕都能闻到——AI 内容生成这条赛道现在还是群魔乱舞的蓝海阶段,谁先抢住位置谁就能卡住生态。

更关键的是,他们居然把这套核心引擎给开源了。

开源什么概念?就是谁都能免费用、随便魔改、集成到自己产品里拿去卖。大厂以前哪有这么大方。

感觉他们真急了。

准备去干短视频了

整个下午我啥也没干,就在那儿反复折腾这个项目。

越用心里越冲动。

之前你要是想做条能看的短视频,哪怕是个三分钟的,脚本得写一两个小时,素材得自己拍或者到处扒,剪辑再耗上大半天,最后找音乐找配音又是一个钟头。没有半天时间根本下不来,还得有台好相机、有个干净的背景、有一张勉强能上镜的脸。

哪怕是用其他的 AI,要么成本巨高,要么麻烦的要死。哪有现在这种随便给个主题,几分钟就能出来的方便!虽然效果说不上多惊艳,但是成本低呀!

以前因为生产效率卡在那里,一个人卯足劲也就能玩转一两个号。现在生成成本趋近于零了,一个人能不能同时搞十个号?上百个号?通过矩阵把流量吃干抹净?

这些问题的答案我现在给不出来,但我知道,Pixelle-Video 这种东西冒出来,就已经标志着某个转折点到了。

在内容严重过剩的时代,真正的稀缺品不再是你能产出多少数量,而是你那颗脑袋里还能蹦出多少别人想不到的点子。

最后说两句

如果你只是好奇想玩玩,或者自己就是做短视频、搞自媒体的,这玩意儿真的值得摸一把。

GitHub 直接搜 Pixelle-Video 或文章底部 点击原文 就能直达

Windows 的兄弟下整合包,macOS/Linux 的朋友敲那几行命令,用不了一根烟的功夫就能跑起来。

它或许不能马上让你财务自由,但一定能让你看见那个正在快速逼近的未来。

大时代嘛,没人能躲,那就迎上去呗。

看完觉得还行,就随手点个赞或者在看,感激不尽。下次有有意思的东西再聊。