大家好,我是你的 AI 观察者。最近刷到 Anthropic(Claude 的母公司)的一篇技术博客,读完后忍不住想立刻分享:《Building agents that reach production systems with MCP》。

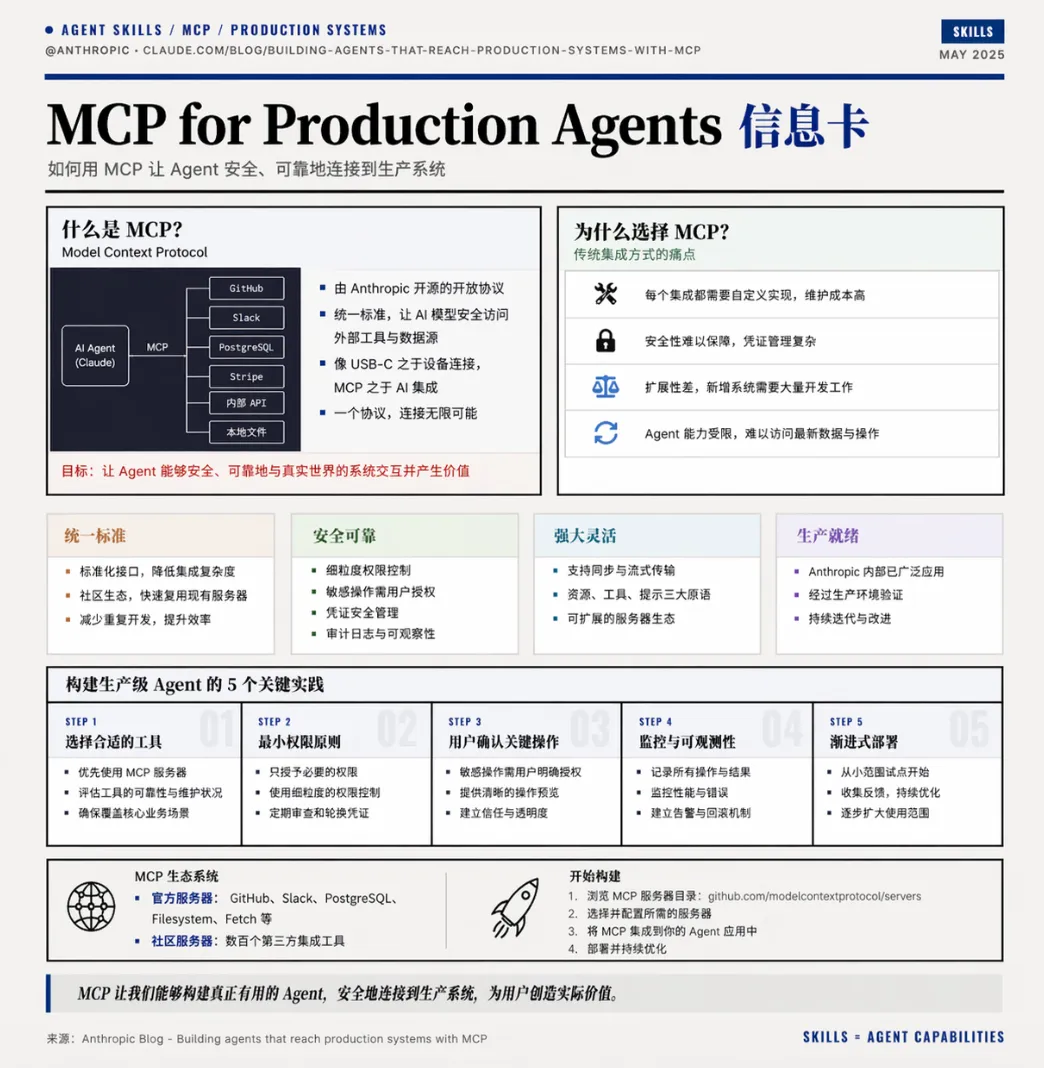

一句话总结:代理(Agent)有多强大,取决于它能“触达”多少真实系统。而 MCP(Model Context Protocol,模型上下文协议)正是那个让 AI 代理真正走进生产环境的“通用桥梁”。

为什么传统方式做生产级代理这么难?

想象一下,你想让 Claude 或其他大模型代理帮你自动处理工作:查数据库、操作云服务、创建 Jira Issue、发 Slack 消息……

过去有三种常见连接方式:

• 直接调用 API:最灵活,但每个代理和每个服务都要单独对接,M 个代理 × N 个服务 = 灾难级的集成工作。一旦 API 改版,全线崩溃。 • 命令行工具(CLI):适合本地,但云端生产环境用起来笨重、安全性差。 • MCP:一个标准化协议,一个远程 MCP Server,就能被 Claude、ChatGPT、Cursor、VS Code 等各种客户端在网页、手机、云端任意环境中调用。

博客里那句经典的话特别戳我:“Agents are only as useful as the systems they can reach.”(代理的价值,只取决于它能触达的系统。)

MCP 就是为了解决这个“M×N 集成地狱”而生的。它提供统一的认证、工具发现、丰富语义和安全机制,让一个 Server 服务所有客户端,大幅降低维护成本和边缘案例。

MCP 到底怎么工作?核心优势一目了然

1. 标准化 + 可移植性

开发者只需实现一次 MCP Server,就能让各种 AI 客户端轻松接入。不管是网页版 Claude 还是企业云端代理,都能无缝使用。2. 安全与认证更可靠

支持 OAuth + CIMD(客户端实例元数据)标准认证,还有 Vault(凭证保险箱)安全存储和自动刷新 token。生产环境最怕的就是凭证泄露,MCP 把这件事标准化了。3. 上下文效率大幅提升 • Tool Search(工具搜索):按需加载工具,上下文 token 消耗减少 85%。 • Programmatic Tool Calling(程序化工具调用):让代理在代码沙箱里处理结果,而不是把海量数据塞回模型,复杂流程下 token 节省 37%。 4. 更智能的工具设计

不是把几千个 API 端点全扔给模型,而是按“意图”分组。比如 Cloudflare 的 MCP Server,用仅仅 2 个工具(search + execute)就覆盖了约 2500 个端点,只占用 ~1000 token。

博客强调:“Fewer, well-described tools consistently outperform exhaustive API mirrors.”(少量描述清晰的工具,表现远胜 exhaustive 的 API 镜像。)5. 丰富交互能力

支持 MCP Apps(交互式界面,如图表、表单)、Elicitation(动态向用户要输入),让代理不再是“哑巴工具调用机”,而能真正协作。

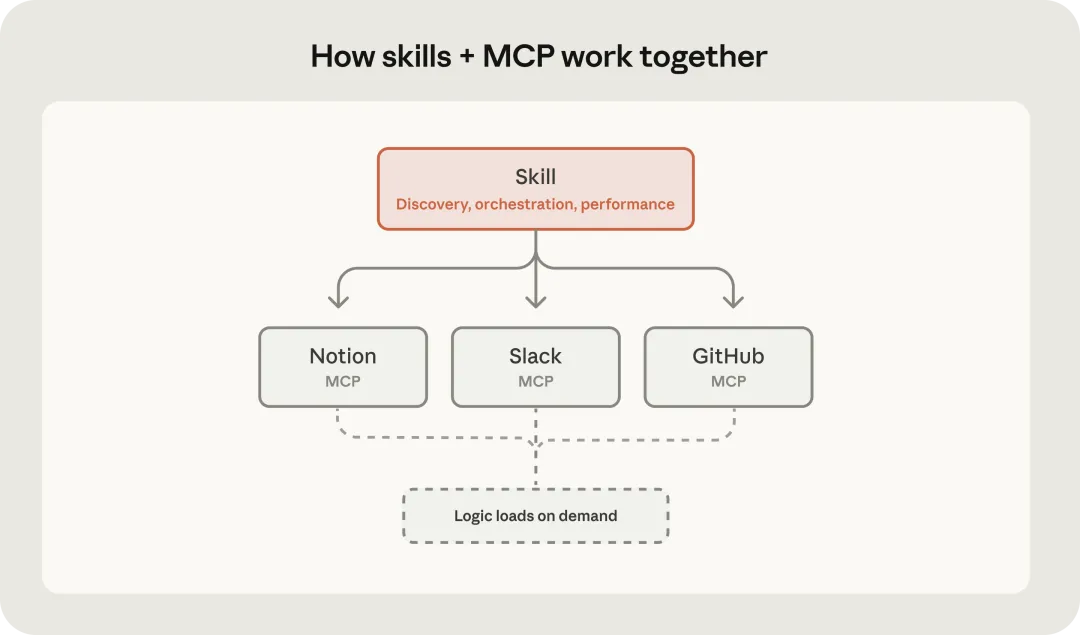

此外,MCP 还能和 Skills(技能) 结合:MCP 负责连接外部系统,Skills 注入领域专家知识,二者搭配,代理就能像真正的“领域专才”一样工作。

真实采用情况如何?

• MCP SDK 下载量已超 3 亿次/月,增长迅猛。 • Cloudflare、Canva、Notion、Sentry 等公司已发布 MCP Server 或 Skills。 • Anthropic 自己的 Claude Cowork、Claude Managed Agents、Claude Code 等产品都在大规模使用。 • 社区已建起数千个 MCP Server,生态正在快速 compounding(复利增长)。

Anthropic 的观点很明确:在云端生产环境中,MCP 正在成为关键层。未来成熟的集成会同时提供 API、CLI 和 MCP,而 MCP 才是让代理真正“落地”的那一个。

MCP 代表了从“提示工程”到“系统集成”的重要演进

原文链接:https://claude.com/blog/building-agents-that-reach-production-systems-with-mcp (强烈建议点进去读原文,技术细节和图表更清晰)

读完后我最大的感受是:AI 代理从“能聊天”到“能干活”,MCP 可能是那个关键的“基础设施”。生态越强,每个人构建的生产级代理就越容易、越安全、越强大。

你觉得呢?

欢迎在评论区聊聊!

喜欢这类 AI 技术解读的朋友,记得关注我,后续会继续带来更多前沿干货。一起让 AI 真正好用起来!?